吉永 智明

日立製作所 研究開発グループ

Lumada Data Science Lab 主任研究員

2004年 東京工業大学大学院計算工学科修士課程修了後、日立製作所入社。中央研究所にて、民生用カメラ・テレビ向けの画像認識、機械学習技術の研究開発に従事。2015年から2018年に日立アメリカ社の研究開発部門に出向。2020年から現職にて、Public Safety分野向けの映像解析研究のプロジェクトのリーダーを務める。

めざすのは人間の能力を拡張するAI。

映像解析技術で災害現場の安全を支援する

「Lumada Data Science Lab.」(以下、LDSL)を「CROSS LDSL」の視点から紐解いていくインタビューシリーズ。今回話を聞いたのは、LDSLでPublic Safety分野向けの映像解析研究のプロジェクトリーダーを務める吉永智明です。災害状況をAIで把握する映像解析システムがコンペティションで得た評価や社会イノベーションについて語ってもらいました。

―― 災害状況をAIで瞬時に把握する映像解析システムがアメリカ国立標準技術研究所(NIST)主催のTRECVID2020でトップレベル精度を得たとお聞きしました。そもそもコンペに参加することになったきっかけは何だったのでしょうか。

2015年に当時の同僚がコンペに参加したいと手をあげたのが最初のきっかけです。参加することに決めた理由は、トップの研究者たちと競うあうことで自分のレベル、位置を知ることができるからです。自分たちの実力を客観的に確認したいという思いがありました。また、多くのデータを扱える機会になることも魅力でした。2015年から継続的にTRECVIDに参加していますが、参加タスクは適宜見直しています。

AI業界ではコンペが盛んです。評価が実力を示すエビデンスになるので、Kaggleという世界的に注目されているコンペにも積極的に参加しています。日立では、研究所だけではなく、ビジネス部門の方々も参加していますね。参加しなかったコンペもどのような技術が出ているのかチェックしています。

―― 会社もコンペへの参加を推奨しているのでしょうか?

日立は大きな会社なので部署によって取り組み方は違いますね。研究所では、世界一・世界初の技術開発を目標の一つとしており、コンペの参加が推奨されています。とはいえ、今回のコンペに参加するにあたっては、自分達でしっかりと予算をつけて、1年のプロジェクトのうち3カ月間は専従して取り組む体制を作りました。

投資に見合ったリターンを会社に返せるように、成果をしっかり残すことを意識していたので、今回のコンペの結果には安心しました。ただ、必ずしも結果だけがリターンではなく、コンペに参加することで、技術が洗練されることや、最後までやり抜いて成果を出す忍耐力の養成もコンペの良い点だと思いますね。

―― どのような点が評価されたのでしょうか?

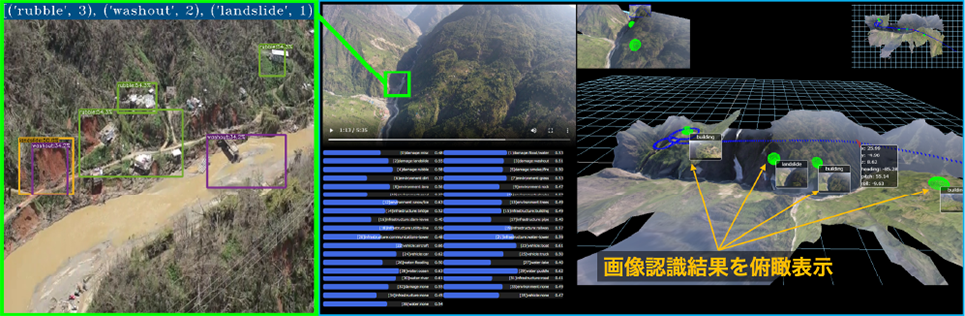

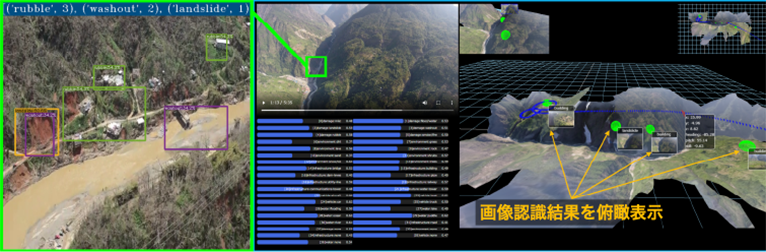

コンペではドローンやヘリコプターが空撮した映像から32種類の災害状況を解析することが求められました。評価されたポイントは、洪水など被害が広範囲に及ぶ災害でも、小さな物から大きな物まで解析し、状況判断ができたことです。

参加者には与えられたデータが正しいかどうかは知らされていません。正解情報が分からない、手探りの状態で学習結果の数値やこれまでの知見をうまく活用して、精度を上げていくことに苦労しました。それでも高い精度で認識できるAIのモデルを作ることができた点が評価されました。

このような技術を応用することで、災害に対応する消防や救助、復興に携わる方々の“目”を10倍、100倍にできます。そうすると、人の作業量を減らせると考えています。空撮は広いエリアを対象としているので、対象物が小さければ小さいほど、発見する難易度が上がります。今後はさらに精度を高め、災害現場で役立つものにしていきます。

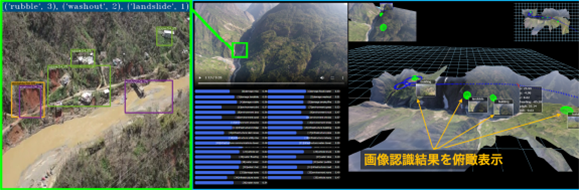

空撮映像を用いた災害状況の把握による災害対応の支援

空撮映像を元に多種の災害状況をAIを介して小さなものから大きなものまで解析を行うことができるAIシステム。

※rubble = 家屋崩壊、washout = 洪水、landslide = 土砂崩れ

―― コンペに出ることによって培われた技術が実際の社会課題の解決に役立つわけですね。

災害が起きてしまった後の計画立案を迅速化し、復興を早めることへの利用も期待できます。もちろん一足飛びにはいきませんが、洪水や土砂災害の規模、道路の寸断をAIで把握することで、復興のための予算計画や防災にも活かせます。

また、洪水などで逃げ遅れた人がいることがこの技術で分かるようになれば、ヘリコプターをどこに飛ばすのかを瞬時に判断できるので、これまで救えなかった命を救うことも可能になるのではないかと考えています。

日立には国や自治体とのチャネルや実績があるので、コンペで培った技術をベースに製品やサービスを展開することで、災害という社会課題の解決に貢献できると思います。私たちの技術を現場などで使えるものにするために、まずお客さまの業務内容を把握することが大切です。「NEXPERIENCE(ネクスペリエンス)」*1という顧客協創の方法論を使うことで、どのようなアプリケーションを作ればお客さまの仕事を真にサポートする技術をスムーズに導入できるかを検討し、製品やサービスに落とし込むことができます。LDSLには、そのために必要なデータサイエンスの人財が集まっていますね。

―― 災害対策にAIを導入する狙いについて教えてください。

「AIは疲れない」、これは共同研究をしている国立情報学研究所(NII)の佐藤真一教授の言葉で、まさにこれがAI導入の最大の効果だと考えています。肉体的にも精神的にも過酷な災害現場で、同じ人が24時間ずっと画面を見続けることはできません。疲れてくるとどうしても見落としや判断の鈍りが発生してしまいますので、その部分をAIでサポートできると考えています。AIが「ここだけ見ればいいですよ」と、情報の取捨選択をすることで、人間の疲労を軽減できます。そうすることによって、見落としを減らせると考えています。

例えば、南紀白浜空港で実施しているX線による手荷物検査の映像解析が分かりやすい実証実験としてあげられます。AIが飛行機に持ち込めないハサミやペットボトルを見つけることによって、人間はチェックする対象を絞れるので、判断が難しい形状の物体だけに集中できるようになります。そうすると、手荷物検索のスループット向上が期待できます。例えば、ある別の実証実験では、AIの導入によってスループットが40%上がったという結果も出ています。

―― AIが人に取って代わるのではなく、サポートするということでしょうか?

AIを導入する本質は、労力の軽減ではなく、人の能力の拡張です。最後の判断は人がするので、AIに全部を任せるということにはならないと考えています。災害の話に戻すと、救助を求めている人や兆候を今までの何倍も見つけられるようになる可能性があります。また、人はスキルや経験にばらつきがありますが、AIのサポートによって、熟練者と同じような成果を多くの人が出せるようになります。

他にも人の能力を拡張している研究開発事例があります。駅などの安全安心、快適性を高めるために防犯カメラの映像解析をしています。不審人物の検知や追跡、体調不良でうずくまっている人や転倒している人、視覚障がい者のサポートをAIで行う研究開発です。このような画像・映像解析技術の研究開発が今回の災害対策のAIにもつながっています。

―― さまざまな研究開発の成果を活かすための仕組みについて教えてください。

お客さま・社会に向けては、まさに弊社が進めるLumadaがそれにあたります。私たちが作った技術やソリューションはLumadaに登録されて、お客さまとの協創にも活用されています。一方、社内の成果共有・活用としては、研究報告の取り組みがあります。研究者は1年の成果を報告書にまとめています。論文に書けないような独自のノウハウや実ビジネスにおける課題もナレッジとして蓄積していくことによって、他の人がその成果を活用できるシステムになっています。

日立の研究開発拠点「協創の森」

Lumadaはさまざまな事業領域のお客さま・パートナーとともに、デジタル技術による社会イノベーションに取り組んでいます。

今回の取材地である「協創の森」は、イノベーションの発信基地をめざした研究開発拠点として創設されました。オープンな協創やNEXPERIENCEなどを用いて、英知と技術の融合によるイノベーションを発信していきます。

―― 災害現場におけるAIの未来についてどのように考えていますか?

災害の予兆を見つけることによって、迅速な避難を促して被害を軽減することや、防災に貢献したいです。AIが映像を解析し、異変の根拠を言葉で説明できるようになれば、人が確認の必要性を判断できるようになります。そういった部分が今後、期待されています。

災害はグローバルな課題です。地球温暖化に伴って気候変動が起きて、災害が増えています。さらに、都市化が進んでいることによって、災害発生時の被害が甚大化していて、統計上の災害被害額は増加の一途をたどっています。事前に防ぐことと同時に、被害が起きた時に対処できるレジリエントな社会にしていくことが必要だと考えています。社会イノベーションのナンバーワンをめざし、私自身もそこに寄与していきたいですね。